聊一个很多人问过我的问题:SEO到底在做什么,日常工作怎么铺开。

SEO工作到底包含哪些模块

很多人以为SEO就是发外链、写文章、堆关键词。实际接触过几个完整项目之后,你会发现它是一个系统工程。我习惯把SEO拆成六个模块来看。

1. 技术SEO

这是地基。技术层面出问题,后续所有努力都可能白费。核心要盯的有:

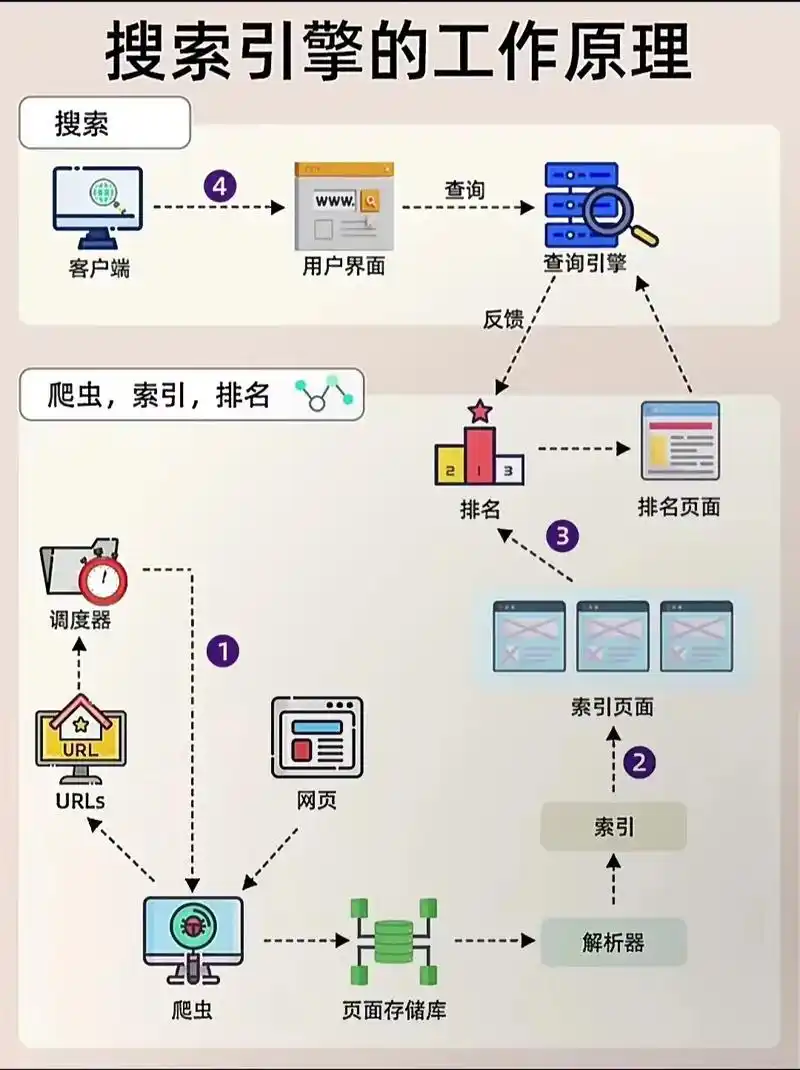

- 抓取和索引。确保搜索引擎能顺利访问页面,并且只索引你希望被收录的内容。检查robots.txt有没有误屏蔽、sitemap是否完整、URL参数有没有造成无限爬取。

- 网站速度。Core Web Vitals是直接影响排名的因子。LCP要控制在2.5秒以内,INP在200毫秒以内,CLS低于0.1。

- 移动端适配。Google从2019年开始默认移动优先索引,页面在移动端的渲染和可用性直接决定排名基准。

- 结构化数据。产品、文章、面包屑、FAQ等类型的Schema标记,能帮搜索引擎理解页面内容,触发富文本搜索结果。

- HTTPS和安全性。证书过期、混合内容警告这些问题,会直接导致排名下降。

- 网站架构。URL层级扁平化,重要页面离首页不超过3次点击距离。

2. 关键词策略

不是拍脑袋想几个词就开始写。需要系统化操作:

- 词库搭建。用SEMrush、Ahrefs或Google Keyword Planner,按核心词、长尾词、疑问词、对比词分类整理。一个中型站点词库量级通常在5000-20000个词条。

- 搜索意图判断。同一个词,用户是想买、想学、还是想找具体网站?这决定了页面类型是产品页、文章页还是工具页。

- 竞品词分析。找到竞品有排名而你没有的词,评估难度和转化价值,决定是否跟进。

- 内容缺口分析。把竞品排名前20的页面和你自己的页面做对比,找出你没有覆盖的话题。

3. 页面优化

拿到关键词之后,怎么落到页面上:

- 标题标签。核心词前置,长度控制在50-60个字符,每个页面标题唯一。

- 描述标签。虽然不直接影响排名,但影响点击率。160个字符以内,包含核心词和行动号召。

- H标签层级。H1唯一,包含主关键词。H2/H3按逻辑层级展开,不要跳级。

- 内容质量。Google的Helpful Content系统评估的是内容是否真正满足用户需求。原创性、深度、引用来源都会影响评估结果。

- 内链。相关页面之间互相链接,锚文本使用描述性文字而非"点击这里"。

- 图片优化。文件名用描述性文字,alt属性准确描述图片内容,格式优先WebP,尺寸按实际显示宽度压缩。

4. 内容策略与执行

内容不是写得多就行,要有规划:

- 内容日历。按季度规划,覆盖目标关键词,保持更新频率稳定。

- 内容类型。教程类、对比类、列表类、案例类,不同类型对应不同搜索意图。

- 更新机制。存量内容定期review,数据下降的页面优先优化,可以更新数据、补充新信息、合并相似页面。

- E-E-A-T。经验、专业、权威、信任,这四个维度是Google质量评估的核心。作者信息、引用来源、实际使用体验的展示都很重要。

5. 外链建设

外链依然是排名的重要因素,但方式变了:

- 资源链接。创建工具、模板、数据报告、行业白皮书这类别人愿意主动引用的资源。

- 数字公关。基于数据的行业报告或独家调研,向垂直媒体投稿获取报道链接。

- 客座博客。在行业相关站点发布文章,但锚文本要自然,不要过度优化。

- 失效链接替换。找到行业网站上的404链接,提供你的相关页面作为替代。

- 品牌提及转化。监控未带链接的品牌提及,联系对方加上链接。

6. 数据分析与监控

没有数据,优化就没有方向:

- 排名监控。核心词每日追踪,长尾词每周追踪,关注波动趋势而非单日变化。

- 流量分析。Google Search Console看点击量、展示量、平均排名、点击率。Google Analytics看用户行为、转化率、跳出率。

- 竞品监控。竞品新上页面、排名变化、内容更新频率,都能提供参考信号。

- 技术监控。定期用Screaming Frog或Sitebulb全站扫描,检查404、重定向链、重复标题、缺失标签等问题。

日常工作怎么开展

我按周为单位来描述日常节奏。实际情况会根据项目阶段调整,但框架基本稳定。

周一:数据复盘日

上午先拉上周的核心数据。几个必看的指标:

| 数据来源 | 关注指标 | 分析目的 |

|---|

| Google Search Console | 总点击量、总展示量、平均排名、CTR | 判断整体流量趋势 |

| Google Search Console | 单页面点击变化(对比上周) | 定位流量波动来源 |

| Google Analytics | 自然搜索流量、跳出率、平均会话时长 | 评估流量质量 |

| 排名追踪工具 | 核心词排名变化、新进前10的词、掉出前10的词 | 发现机会和风险 |

| 服务器日志(如有) | Googlebot抓取频次、抓取预算消耗、抓取错误 | 技术健康度检查 |

数据拉完之后做三件事:

- 标记异常。流量突然下降的页面,查是否被降权、是否被竞品超越、是否有技术问题。

- 标记机会。排名在第4-7位的词,点击率还有提升空间;排名在第11-15位的词,距离首页一步之遥。

- 形成本周优先级列表。哪些页面需要优化、哪些词需要重点推进,排好顺序。

周二到周三:执行优化

这两天集中做需要动手的事情。

页面优化类工作:

- 针对周一标记的"机会页面",优化标题标签和描述标签。标题加入更精准的长尾词,描述加入数字或利益点提升点击率。

- 补充页面内容。如果某个页面覆盖的关键词不够全面,增加相关段落,用H2/H3展开子话题。

- 内链调整。在相关文章之间增加链接,锚文本使用目标关键词的变体。

- 结构化数据检查。用Google的富文本搜索结果测试工具验证Schema标记是否正确。

技术修复类工作:

- 处理Screaming Frog扫描出来的问题。404页面设置301重定向到最相关页面;重复标题重新撰写;缺失的alt属性补上。

- 速度优化。压缩未压缩的图片,清理未使用的JS/CSS,检查服务器响应时间。

- 索引问题。Search Console里"已抓取-未编入索引"的页面,判断是否需要优化内容质量,还是设置noindex。

内容生产类工作:

- 按内容日历写新文章。写之前先看当前排名前5的页面,分析它们覆盖了哪些子话题、内容长度、用了什么类型的素材,然后做得更全面。

- 更新旧内容。选择流量下降超过15%的页面,补充新数据、新案例、新步骤,更新发布时间。

周四:外链和公关

外链工作集中在一天处理效率更高:

- 用Ahrefs或Majestic检查本周新获得的外链,确认来源质量。发现垃圾外链及时用Disavow工具处理。

- 竞品外链分析。看竞品最近获得了哪些新链接,判断能否复制同样的获取方式。

- 联系资源页面。找到行业内的"推荐链接""有用资源"类页面,提交你的工具或文章。

- 跟进之前联系的站长或编辑,确认外链是否上线。

- 监控品牌提及。用Google Alerts或Mention工具,发现未带链接的品牌提及,礼貌联系对方添加链接。

周五:技术审计和下周规划

- 全站技术扫描。用Screaming Frog跑一遍全站,导出问题列表,按严重程度排序。

- 检查sitemap更新状态,确认新增页面已被包含。

- 检查robots.txt没有被误修改。

- 查看Search Console的手动操作和安全性问题,确保没有惩罚通知。

- 整理本周完成的工作和效果数据,形成简要记录。

- 确定下周的优先级:哪些页面继续优化、哪些新词要启动、哪些技术问题要修复。

一些具体场景的操作方法

场景一:新页面如何快速获得排名

- 页面发布后,立即在Search Console提交URL,请求编入索引。

- 在站内已有的高权重相关页面添加内链指向新页面。

- 如果内容适合,在社交媒体账号发布并引导讨论。

- 通过邮件列表推送给已有用户或订阅者,获取初始流量信号。

- 一周后检查是否被收录,未收录则检查内容质量和抓取状态。

场景二:排名突然下降怎么排查

- 确认是单个页面下降还是整站下降。整站下降优先检查技术问题(robots.txt、服务器、惩罚通知)。

- 单个页面下降,先看是否被Google更新影响。对比更新发布时间和排名下降时间。

- 检查页面是否被他人修改(标题、内容、noindex标签)。

- 检查竞品是否更新了内容或获得了新外链。

- 检查页面速度是否变慢,移动端是否正常渲染。

- 用site:命令检查页面是否仍在索引中。

场景三:老页面流量持续下滑

- 分析搜索词报告,看哪些词排名下降,判断是内容过时还是竞品超越。

- 更新页面数据、案例、截图到最新版本。

- 扩展内容深度,覆盖用户可能关心的相邻问题。

- 检查页面加载速度,老页面可能积累了过多未优化的图片或脚本。

- 从高流量页面增加内链指向该页面。

需要持续关注的几个方向

- Google算法更新。关注Google Search Central博客和Search Engine Roundtable这类行业媒体,更新发布后对比自己站点的数据变化。

- AI对搜索的影响。Google的SGE和AI Overviews正在改变搜索结果的呈现方式,需要关注你的目标关键词是否触发了AI摘要,以及它对点击率的影响。

- 用户行为变化。定期分析站内搜索词和用户路径,了解用户真正在找什么,调整内容方向。

- 竞品动态。竞品改版、上新内容类型、获得大量外链,都是需要关注和应对的信号。

SEO的日常工作就是这样一个循环:看数据、找问题、动手优化、验证效果、继续看数据。每个环节都需要具体的工具和明确的判断标准,而不是凭感觉做决定。