SEO大牛的隐藏逻辑是什么?流量暴涨真的靠玄学?

- SEO排名

- 2026-04-28 08:51:26

- 1

聊一个被问烂了,但多数人理解有偏差的问题。

我见过太多人把SEO做成了玄学。今天改个标题,明天加个内链,后天去某个论坛发几条外链,然后每天盯着曲线看,涨了就觉得自己掌握了核心科技,跌了就归因于算法波动。这种操作模式,跟猜大小没有本质区别。

真正的SEO大牛,脑子里跑的不是什么奇技淫巧,而是一套完整的逻辑推演系统。他们看到的东西,和你看到的不一样。

### 你看到的是排名,他们看到的是查询意图的满足率

多数人拿到一个词,第一反应是看竞争度、看搜索量、看竞价广告数量。这些数据要看,但这是基本功,不是决策依据。

大牛拿到一个词,脑子里拆解的是这样一张表:

| 分析维度 | 普通操作者关注点 | 大牛关注点 |

|---------|----------------|-----------|

| 搜索结果页特征 | 有多少个首页网站 | 前10名分别满足了哪类意图 |

| 内容形态 | 写文章还是做视频 | 用户点开这个结果后,期望得到什么格式的答案 |

| 交互深度 | 停留时间够不够长 | 用户看完这条结果后,是否还需要二次搜索 |

| 信息缺口 | 竞品写了什么 | 竞品没写什么,以及用户评论区在追问什么 |

这套分析逻辑的核心在于:搜索引擎的排序模型,本质上是在模拟一个“用户满意度预测”的过程。它通过点击率、停留时长、回搜率、直接访问比例等行为信号,反向推断哪个页面最可能让用户满意。

所以大牛做的是,在动手写第一个字之前,已经把搜索结果页上所有对手的“满足程度”拆解了一遍。他们找的不是哪个词好做,而是哪个词的需求没有被现有结果充分满足。

这个缺口,才是流量暴涨的真正起点。

### 你看到的是内容长度,他们看到的是信息增益

有一个流传很广的错误认知:长内容排名好。于是很多人硬生生把800字能说清的事,水成3000字。

实际情况是,搜索引擎在评估内容质量时,有一个核心概念叫信息增益。简单说就是:你的页面给用户提供了多少他之前不知道的、有价值的信息。

这不是字数的问题,是信息密度的问题。

大牛的操作方式是,在覆盖同一个话题时,他们会系统性地检查竞品内容中缺失的环节:

- 竞品只讲了“是什么”,没讲“在什么条件下不适用”

- 竞品列举了步骤,但没给出每个步骤可能遇到的报错及解决方法

- 竞品引用了某个数据,但没标注数据来源和时效性

- 竞品给出了通用方案,但没区分不同场景下的变体操作

这些缺失的环节,就是信息增益的切入点。你不需要写得比竞品长,你需要写得比竞品完整。完整不等于啰嗦,完整等于用户看完你的内容之后,不需要再去别的地方找补充。

### 你看到的是外链数量,他们看到的是引用网络的拓扑结构

外链建设是SEO里最容易被妖魔化的环节。一端是“外链已死”的论调,另一端是各种群发软件的黑产玩法。

大牛看外链,看的不是数量,是三层结构:

**第一层:种子站群的构建逻辑**

不是去垃圾站群买链接,而是在自己所在领域内,识别出那些真正有引用价值的节点。这些节点包括:

- 行业标准制定组织的官网

- 被广泛引用的开源项目文档页

- 学术机构发布的行业报告页面

- 头部企业的技术白皮书页面

这些页面有一个共同特征:它们本身不卖链接,但它们是整个领域引用网络的枢纽。你的内容如果能被这些页面引用,获得的不只是权重传递,更是一种“主题相关性”的强信号。

**第二层:引用路径的可信度衰减**

从种子节点出发,每经过一层引用,信任度会衰减。大牛会计算自己的页面距离核心种子节点有几层引用距离。距离越短,信号越强。

这就是为什么同样一条外链,放在一个被.edu域名引用的页面上,和放在一个孤立的博客上,效果天差地别。不是因为.edu域名有什么魔法,而是因为它在引用网络中的位置更靠近核心。

**第三层:引用上下文的语义关联**

搜索引擎现在会分析链接周围的文本内容。一条链接如果被包裹在高度相关的论述段落中,其传递的权重远高于一条放在侧边栏或页脚的孤立链接。

大牛做外链建设,追求的不是链接数量,而是“在高度相关的上下文中,被权威节点引用”的质量。这种链接,一条顶一千条垃圾链接。

### 你看到的是技术优化,他们看到的是爬行预算的分配策略

技术SEO被很多人等同于“把网站速度搞快、把URL搞干净、加上结构化数据”。这些都对,但只是基础。

大牛关注的是另一个层面的问题:搜索引擎给你的网站分配了多少爬行预算,以及这些预算被消耗在了什么地方。

对于一个有几万甚至几十万页面的网站,搜索引擎不可能每次都把所有页面爬一遍。它会根据你网站的历史表现、更新频率、页面重要性等信号,动态分配爬行资源。

这里面有几个可以主动干预的点:

**控制索引膨胀**

很多网站最大的问题是,真正有价值的内容页面可能只有几千个,但因为URL参数、筛选组合、分页等原因,生成了上百万个低质量页面。搜索引擎把大量爬行预算消耗在这些页面上,真正重要的页面反而得不到及时抓取。

大牛会通过以下手段精确控制:

- 在robots.txt中禁用特定参数路径

- 对筛选结果页使用canonical标签指向主页面

- 在Google Search Console中手动限制特定目录的抓取频率

- 对分页序列使用rel="next"和rel="prev"标记,避免被当作独立页面处理

**优化内部链接的爬行路径**

搜索引擎的爬虫是通过链接来发现页面的。如果你的重要内容需要点击七八次才能从首页到达,爬虫可能根本不会走那么深。

大牛会设计一个扁平化的内部链接结构,确保任何重要页面距离首页不超过3次点击。这不是为了用户体验,这是为了让爬虫能高效地发现和更新你的核心内容。

**日志分析驱动决策**

这是大牛和普通操作者之间最大的分水岭。大牛会定期分析服务器日志,看搜索引擎爬虫实际在做什么:

- 哪些目录被频繁抓取,哪些目录被忽略

- 爬虫是否在某个参数组合上陷入了无限循环

- 抓取频率是否与页面更新频率匹配

- 是否有大量抓取请求返回了404或500状态码

这些数据能告诉你搜索引擎实际如何看待你的网站,而不是你希望它如何看待。基于日志的优化,每一刀都砍在要害上。

### 你看到的是算法更新,他们看到的是信号权重的重新分配

每次搜索引擎发布算法更新,行业里就一片哀嚎或者狂欢。大牛对此的反应通常很平淡,因为他们理解一个底层逻辑:

搜索引擎的算法更新,本质上是在调整各种排名信号的权重比例。它不会突然把垃圾内容捧上天,也不会突然把优质内容打入冷宫。它只是在重新分配权重。

大牛在算法更新时做的事情:

1. 先不做任何改动,观察一周的数据波动

2. 对比更新前后,搜索结果页上排名变化的页面类型

3. 分析被提升的页面和被降级的页面之间,在内容特征、技术指标、用户行为数据上的差异

4. 反向推断这次更新加重了哪些信号的权重,降低了哪些信号的权重

5. 根据推断调整自己的优化策略

这个过程需要的是逻辑推演能力,不是小道消息。那些在更新当天就急着改这改那的人,通常是在用新的错误覆盖旧的错误。

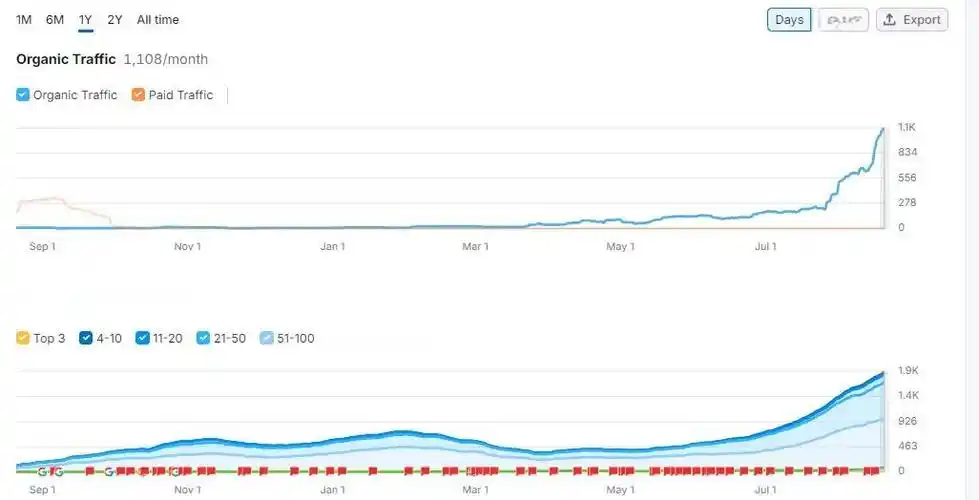

### 流量暴涨的触发条件

流量暴涨不是玄学,它是一系列条件同时满足时的必然结果:

- 你选择了一个存在信息缺口的查询意图

- 你产出的内容在信息增益上显著高于现有结果

- 你的页面在技术层面没有阻碍爬虫和用户的访问

- 你的内容在引用网络中获得了足够高质量的引用

- 用户行为数据验证了搜索引擎的预测,形成了正向循环

这五个条件缺一不可。那些看起来“突然”暴涨的流量,背后是这五个条件在某个时间点同时被满足,搜索引擎给了你的页面一个展示机会,然后用户用点击和停留时间投票,把这个机会变成了稳定的排名。

这不是玄学,这是系统工程。

本文由小艾于2026-04-28发表在爱普号,如有疑问,请联系我们。

本文链接:https://www.ipbcms.com/10048.html